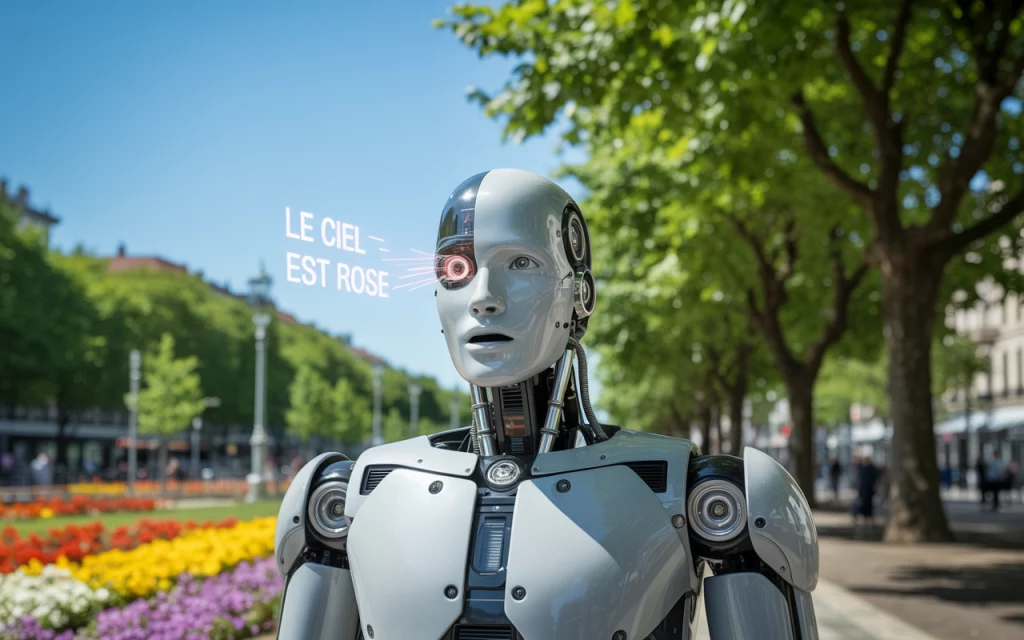

Imaginez : vous confiez à ChatGPT la rédaction d’une stratégie de contenu pour un client pharmaceutique. L’IA vous pond un brief impeccable, citant trois études scientifiques qui valident parfaitement votre approche. Un seul problème : ces études n’existent pas. Bienvenue dans l’univers fascinant et périlleux des hallucinations des modèles de langage (LLM), ce phénomène où … Lire la suite de « ChatGPT vous ment 48 % du temps » : la science révèle pourquoi les IA hallucinent (et comment s’en protéger)

0 Commentaire