Quand les prophètes de la Silicon Valley jouent avec l’avenir d’une technologie révolutionnaire

Il faut que quelqu’un le dise clairement : Sam Altman et ses semblables sont en train de saboter l’avenir de l’intelligence artificielle.

Depuis des mois, le PDG d’OpenAI multiplie les déclarations fracassantes sur l’arrivée imminente de l’Intelligence Artificielle Générale (AGI). En novembre 2024, il affirmait devant Y Combinator que l’AGI serait atteinte en 2025, qualifiant cela de « simple problème d’ingénierie ». En janvier 2025, dans son blog « Reflections », il prétendait qu’OpenAI était « désormais certain de savoir comment construire l’AGI ». Et pour couronner le tout, il tweete cryptiquement sur la « singularité » comme si nous étions à deux doigts de voir naître Skynet.

Ces déclarations ne sont pas seulement prématurées. Elles sont dangereuses.

Petit florilège des déclarations de Sam Altman sur l’AGI et GPT-5 depuis juin 2024 :

| Date | Contexte/Source | Déclaration sur l’AGI | Déclaration sur GPT-5 | Citations clés |

|---|---|---|---|---|

| Mars 2024 | Rencontre avec correspondants coréens | – | GPT-5 aura des améliorations massives par rapport à GPT-4 | « GPT-5 va bénéficier d’une amélioration massive par rapport au GPT-4, faisant un bond en avant dans les capacités de raisonnement avancées » |

| Août 2024 | Post X (teaser) | – | Démonstration des capacités avancées de GPT-5 | Post montrant les capacités sophistiquées du modèle avec la question « What is the most thought-provoking show about AI? » |

| Août 2024 | Lancement de GPT-5 | – | Présentation de GPT-5 comme révolutionnaire | « un véritable expert titulaire d’un doctorat dans n’importe quel domaine, à votre disposition, capable de vous aider à atteindre vos objectifs » |

| Novembre 2024 | Interview Y Combinator | AGI réalisable en 2025, chemin « fondamentalement clair » | – | « AGI could be achieved in 2025 during an interview for Y Combinator, declaring that it is now simply an engineering problem » |

| Novembre 2024 | Interview Y Combinator (suite) | « What are you excited about in 2025? » – « AGI » | – | « What are you excited about in 2025? » « AGI, I’m excited for that » |

| Novembre 2024 | Symposium FinRegLab AI | Le terme « AGI » devient obsolète | – | « Je pense que c’est un terme peu utile […] plutôt que ce binaire de, ‘est-ce de l’AGI ou non ?’ » |

| Janvier 2025 | Blog post « Reflections » | « Nous sommes confiants de savoir comment construire l’AGI » | – | « Nous sommes désormais certains de savoir comment construire l’IAG et que les agents d’IA entreront sur le marché du travail en 2025 » |

| Janvier 2025 | Tweet cryptique du Nouvel An | Référence à la « singularité » | – | « near the singularity; unclear which side » |

| Janvier 2025 | Interview Bloomberg | Prédiction AGI 2025 basée sur intuition de 2019 | – | « I remember thinking to myself back then that we would do it in 2025, but it was a totally random number based off of 10 years from when we started » |

Sam Altman

By TechCrunch – TechCrunch Disrupt San Francisco 2019 – Day 2, CC BY 2.0, https://commons.wikimedia.org/w/index.php?curid=92008259

L’histoire se répète : les leçons oubliées des hivers de l’IA

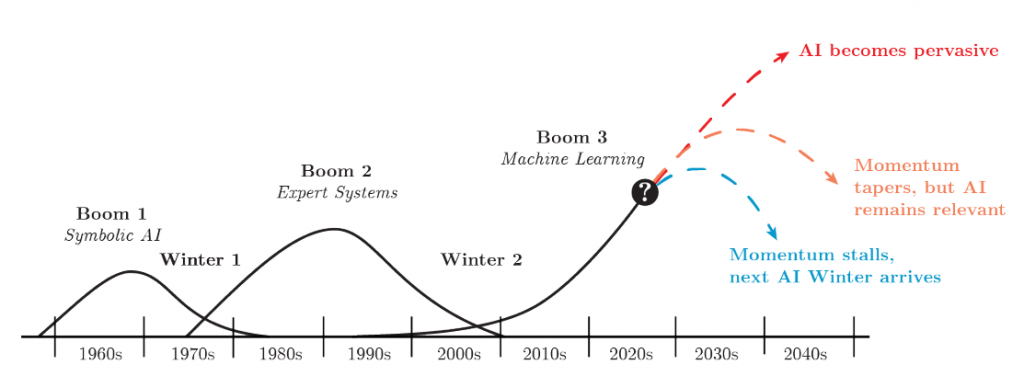

Ceux qui connaissent l’histoire de notre discipline savent que l’intelligence artificielle a déjà traversé deux « hivers » majeurs – des périodes de désillusion massive où les financements se sont taris après que les investisseurs ont découvert l’ampleur du fossé entre les promesses et la réalité.

Le premier hiver (années 1970) a suivi l’effondrement des espoirs autour des réseaux de neurones et de la traduction automatique. Le second (fin des années 1980-début 1990) a sonné le glas de l’engouement pour les systèmes experts après que les entreprises ont réalisé qu’elles avaient investi des milliards dans des technologies finalement très limitées.

À chaque fois, le scénario était identique : des chercheurs brillants mais naïfs, soutenus par des entrepreneurs avides de financements, ont vendu aux investisseurs et au public des rêves de machines pensantes imminentes. À chaque fois, la réalité technique a rattrapé le marketing. À chaque fois, la désillusion a été brutale et les conséquences désastreuses pour toute une génération de recherches prometteuses.

Nous sommes dans un nouveau boom de l’IA, mais aussi à un point d’infléchissement : si l’investissement se maintient, c’est peut être l’annonce d’un monde où l’intelligence artificielle deviendra omniprésente. Mais on peut aussi connaître un nouvel hiver de l’IA.

Image taken from Harguess, J., & Ward, C. M. (2022). Is the Next Winter Coming for AI? Elements of Making Secure and Robust AI. 2022 IEEE Applied Imagery Pattern Recognition Workshop (AIPR), Applied Imagery Pattern Recognition Workshop (AIPR), 2022 IEEE, 1–7.

Le déni de réalité technique

Regardons les faits avec lucidité. GPT-5, présenté par Altman comme « un véritable expert titulaire d’un doctorat dans n’importe quel domaine », s’est révélé être un tel fiasco à son lancement qu’OpenAI a dû faire marche arrière et réintroduire GPT-4o en catastrophe. Les utilisateurs parlent d’un « service inutilisable en entreprise » qui confond l’Oregon avec « Onegon » et pense que Joe Biden est encore président.

Comment peut-on sérieusement parler d’AGI quand notre modèle le plus avancé échoue sur des tâches que maîtrise un enfant de 10 ans ?

L’AGI, par définition, suppose une intelligence capable de comprendre, apprendre et appliquer des connaissances dans n’importe quel domaine au niveau humain. Nous en sommes à des années-lumière. Nos meilleurs modèles actuels sont des outils certes beaucoup plus puissants qu’autrefois et dotés de capacités jugées impensables il y’a peu. Mais ils ne sont capables de briller que sur des tâches spécifiques et sont encore dépourvus de toute compréhension véritable du monde.

La course à l’échalote technologique

Le problème dépasse largement Altman. Toute la Silicon Valley est prise dans une course démente où chaque patron de GAFAM doit annoncer quelque chose de plus révolutionnaire que son concurrent. Musk promet des robots humanoïdes pour « avant 2027 », Google évoque des « agents AGI » pour demain, Meta développe des modèles qui « dépasseront bientôt l’intelligence humaine ».

Cette surenchère permanente crée un écosystème toxique où la vérité scientifique est sacrifiée sur l’autel du buzz médiatique et des levées de fonds. Quand Altman tweete sur la « singularité », il ne fait pas de la prospective technologique : il fait du marketing pour justifier la valorisation démente d’OpenAI à 157 milliards de dollars.

L’armée des pseudo-experts complices

Le plus révoltant dans cette mascarade, c’est la cohorte de prétendus experts qui relaie ces annonces sans la moindre analyse critique. Combien de journalistes tech, d’influenceurs LinkedIn ou de consultants en « transformation digitale » ont-ils la moindre idée de ce qu’est vraiment un transformeur, de comment fonctionne l’attention multi-têtes, ou des limitations fondamentales du pré-entraînement sur corpus textuels ?

Ces relais d’opinion parlent d’AGI comme d’une évolution naturelle des LLM actuels, alors que les vrais défis – compréhension causale, raisonnement abstrait, apprentissage par peu d’exemples, ancrage symbolique – restent largement non résolus. Ils confondent performance sur benchmark et intelligence générale, fluidité conversationnelle et compréhension profonde.

Ce que nous perdons dans cette folie

Le plus tragique, c’est que cette course au sensationnalisme occulte les véritables avancées en cours. Dans les laboratoires de recherche du monde entier, des équipes travaillent sur des architectures révolutionnaires qui pourraient ringardiser les LLM d’aujourd’hui : systèmes neuro-symboliques hybrides, apprentissage continuel, architectures cognitives inspirées des neurosciences, raisonnement causal explicite.

Ces recherches, moins tape-à-l’œil que les démonstrations de ChatGPT mais potentiellement bien plus prometteuses à long terme, risquent d’être les premières victimes du prochain hiver de l’IA. Quand les investisseurs découvriront qu’Altman leur a vendu du rêve, ils ne feront pas le tri entre charlatanisme marketing et recherche sérieuse.

Un appel à la responsabilité

Il est temps que les dirigeants des grandes entreprises tech assument leurs responsabilités. Leur parole a un poids considérable sur les marchés, les politiques publiques et l’opinion. Quand Altman annonce l’AGI pour 2025, il influence des milliards d’investissements, oriente des carrières, façonne les attentes du public.

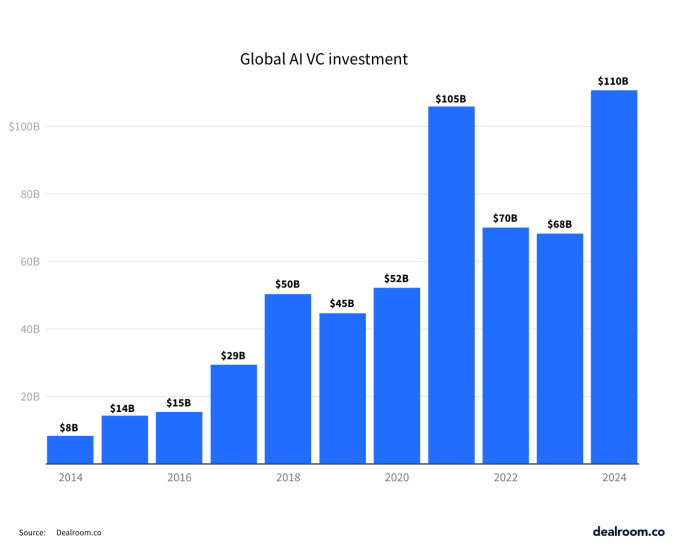

Aux USA, les investissements financiers dans l’IA atteignent des sommets stratosphériques : 110 milliards de dollars. Une promesse non tenue de plus pourrait faire fuir les Venture Capitalists pour longtemps.

Cette responsabilité implique un devoir de vérité. Oui, l’IA progresse à un rythme impressionnant. Oui, les applications actuelles transforment déjà de nombreux secteurs. Oui, les perspectives à moyen terme sont extraordinaires. Mais non, nous ne sommes pas à quelques mois de créer des machines pensantes qui révolutionneront l’humanité du jour au lendemain.

Sauver l’IA de ses prophètes

L’intelligence artificielle est probablement la technologie la plus prometteuse de notre époque. Elle mérite mieux que d’être instrumentalisée par des PDG en quête de valorisations stratosphériques ou des influenceurs en mal de clics.

Il est urgent de retrouver un discours scientifique rigoureux, de célébrer les vrais progrès sans survendre leurs implications, d’investir massivement dans la recherche fondamentale plutôt que dans le marketing. L’IA a le potentiel de transformer positivement nos sociétés – à condition qu’on lui laisse le temps de mûrir sans la saboter par des promesses inconsidérées.

Sinon, dans quelques années, quand la bulle spéculative actuelle aura éclaté et que les investisseurs auront compris qu’on leur a vendu de l’AGI de pacotille, nous vivrons un troisième hiver de l’IA. Et cette fois, il pourrait durer longtemps.

L’intelligence artificielle mérite mieux que Sam Altman et ses promesses de camelot. Il est temps de le dire.

Ce contenu vous a plu ?

Inscrivez-vous gratuitement à notre newsletter et recevez chaque semaine l’actualité du SEO directement dans votre boîte email. Vous pouvez vous désabonner à tout moment !