Définition du Pre-Prompting

6 mars 2026

Le pre-prompting est une technique utilisée lors de l’interaction avec une intelligence artificielle générative. Elle consiste à donner à l’IA des instructions ou un contexte avant la requête principale, afin d’orienter la manière dont elle doit répondre. Ce contexte préalable peut préciser plusieurs éléments : le rôle que l’IA doit adopter, le ton de la

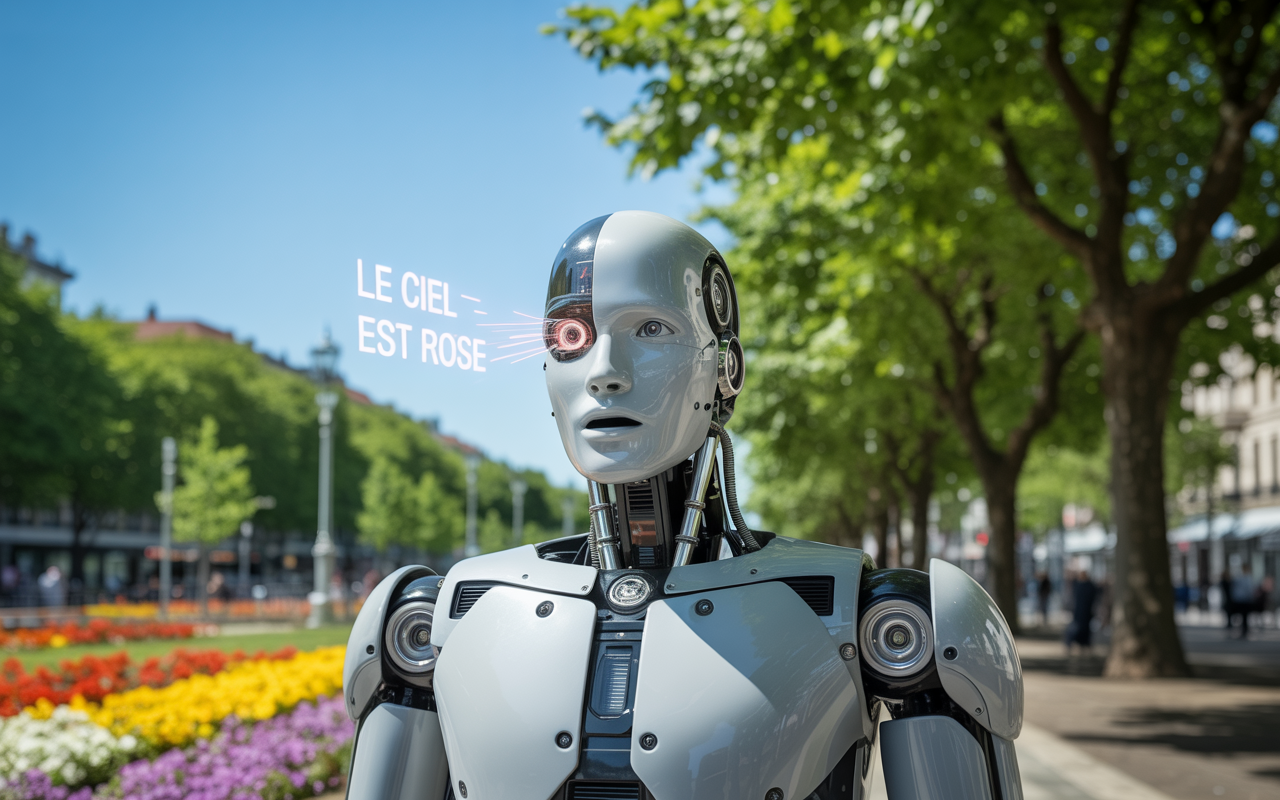

Hallucinations IA : définition, causes et solutions pour limiter les erreurs des modèles

25 février 2026

Les hallucinations IA font partie des limites structurelles des modèles d’intelligence artificielle générative. Le terme peut sembler spectaculaire, pourtant il désigne un phénomène technique bien identifié. Lorsqu’un modèle produit une réponse plausible mais factuellement incorrecte, on parle d’hallucination. Dans un contexte SEO, éditorial, médical ou financier, ces erreurs peuvent avoir un impact direct sur la

OpenClaw : l’agent IA viral qui inquiète déjà les équipes sécurité

20 février 2026

L’IA agentique entre dans une nouvelle phase. Ce qui n’était qu’un projet open source prometteur est devenu en quelques semaines un phénomène viral… puis un sujet d’inquiétude pour les équipes sécurité. D’abord lancé sous le nom Clawdbot, puis renommé Moltbot, le projet est désormais connu sous OpenClaw Moltbot. Derrière ces changements successifs se cache une

Faut-il dire « s’il te plait » quand on demande quelque chose à une IA Générative ?

10 février 2026

L’adoption massive des IA conversationnelles (systèmes d’intelligence artificielle capables de dialogue naturel comme ChatGPT, Claude ou Bard) dans les organisations révèle un phénomène inattendu : 73% des utilisateurs professionnels appliquent spontanément les codes de politesse humains à ces systèmes. Cette habitude comportementale génère des coûts cachés significatifs. Sam Altman, CEO d’OpenAI, a quantifié l’impact :

OpenAI lance un optimisateur de prompt pour améliorer vos prompts en un clic

9 février 2026

Rédiger un bon prompt n’est pas inné. Beaucoup d’utilisateurs d’IA générative obtiennent des réponses décevantes non pas à cause de l’outil… mais à cause de leurs instructions.Bonne nouvelle : OpenAI vient de lancer un prompt optimizer, un outil pensé pour transformer automatiquement un prompt mal formulé en un prompt clair, structuré et efficace. Qu’est-ce qu’un

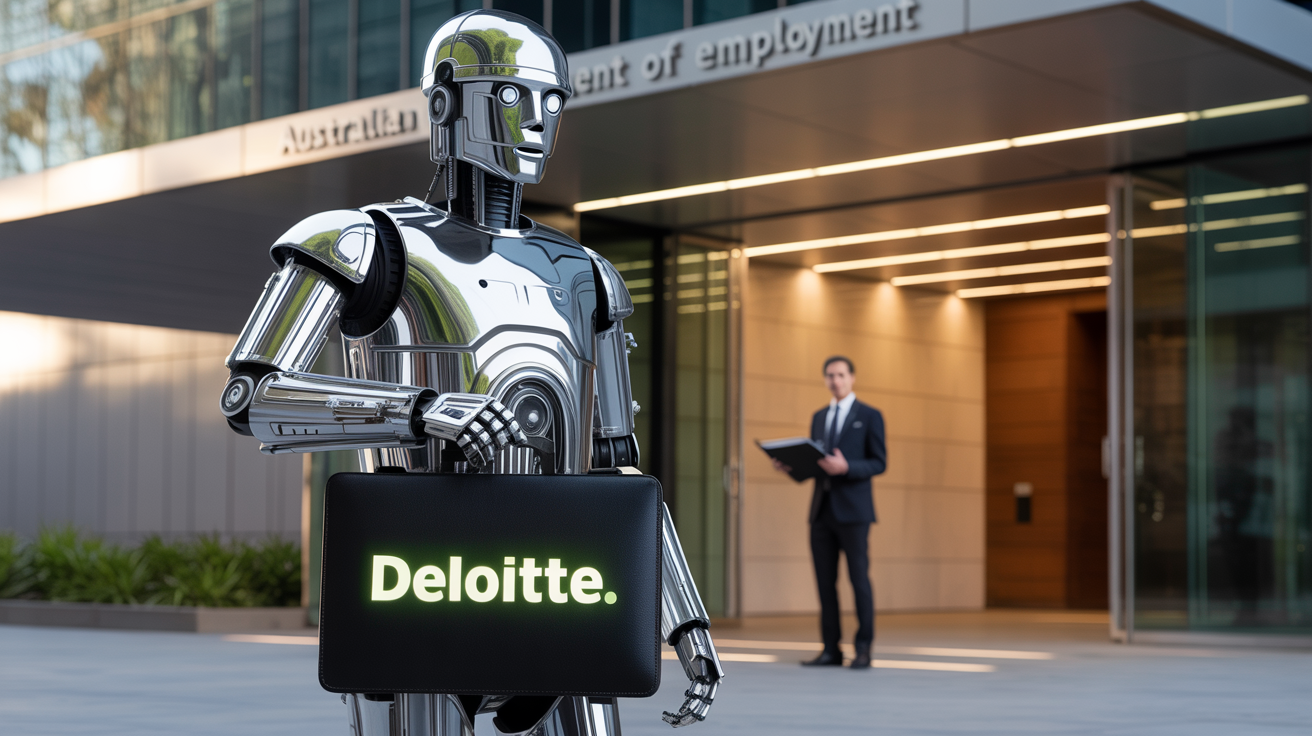

Deloitte pris la main dans le sac : l’IA invente des références dans un rapport à 290 000$ pour le gouvernement australien »

15 octobre 2025

Quand un chercheur de Sydney démasque un rapport gouvernemental de 290 000$ truffé de fausses références générées par ChatGPT Chris Rudge ne s’attendait certainement pas à déclencher un scandale international ce jour d’août 2025 quand il a ouvert le rapport de Deloitte sur son écran. Ce chercheur en droit de la santé et des affaires

« ChatGPT vous ment 48 % du temps » : la science révèle pourquoi les IA hallucinent (et comment s’en protéger)

8 octobre 2025

Imaginez : vous confiez à ChatGPT la rédaction d’une stratégie de contenu pour un client pharmaceutique. L’IA vous pond un brief impeccable, citant trois études scientifiques qui valident parfaitement votre approche. Un seul problème : ces études n’existent pas. Bienvenue dans l’univers fascinant et périlleux des hallucinations des modèles de langage (LLM), ce phénomène où

Moratoire sur l’AI Act européen : la Commission dit non, mais jusqu’à quand ?

2 octobre 2025

Le bras de fer qui secoue Bruxelles Septembre 2025 restera dans les annales comme le mois où l’Europe a révélé ses divisions profondes sur l’avenir de la régulation de l’intelligence artificielle. Au cœur de cette bataille : l’AI Act, cette législation pionnière qui ambitionne de réguler l’IA selon une approche basée sur les risques. D’un

Comment NLWeb et AutoRAG vont changer votre façon d’accéder au contenu web …

2 octobre 2025

L’ère de la recherche par mots-clés touche à sa fin. Après vingt-cinq ans de domination, le paradigme qui a fait la fortune de Google montre ses limites face aux nouvelles attentes créées par ChatGPT, Claude et autres assistants conversationnels. Cloudflare et Microsoft viennent de dévoiler leur réponse à cette mutation : NLWeb et AutoRAG, une