Les hallucinations IA font partie des limites structurelles des modèles d’intelligence artificielle générative. Le terme peut sembler spectaculaire, pourtant il désigne un phénomène technique bien identifié. Lorsqu’un modèle produit une réponse plausible mais factuellement incorrecte, on parle d’hallucination.

Dans un contexte SEO, éditorial, médical ou financier, ces erreurs peuvent avoir un impact direct sur la crédibilité, la performance et la prise de décision. Comprendre leur origine permet de mieux les encadrer et d’en réduire la fréquence.

Définition des hallucinations générées par l’IA

Les hallucinations générées par l’IA correspondent à des contenus inexacts, inventés ou trompeurs produits par un modèle d’intelligence artificielle. Il ne s’agit pas d’un dysfonctionnement isolé, mais d’une conséquence logique du fonctionnement probabiliste des modèles de langage.

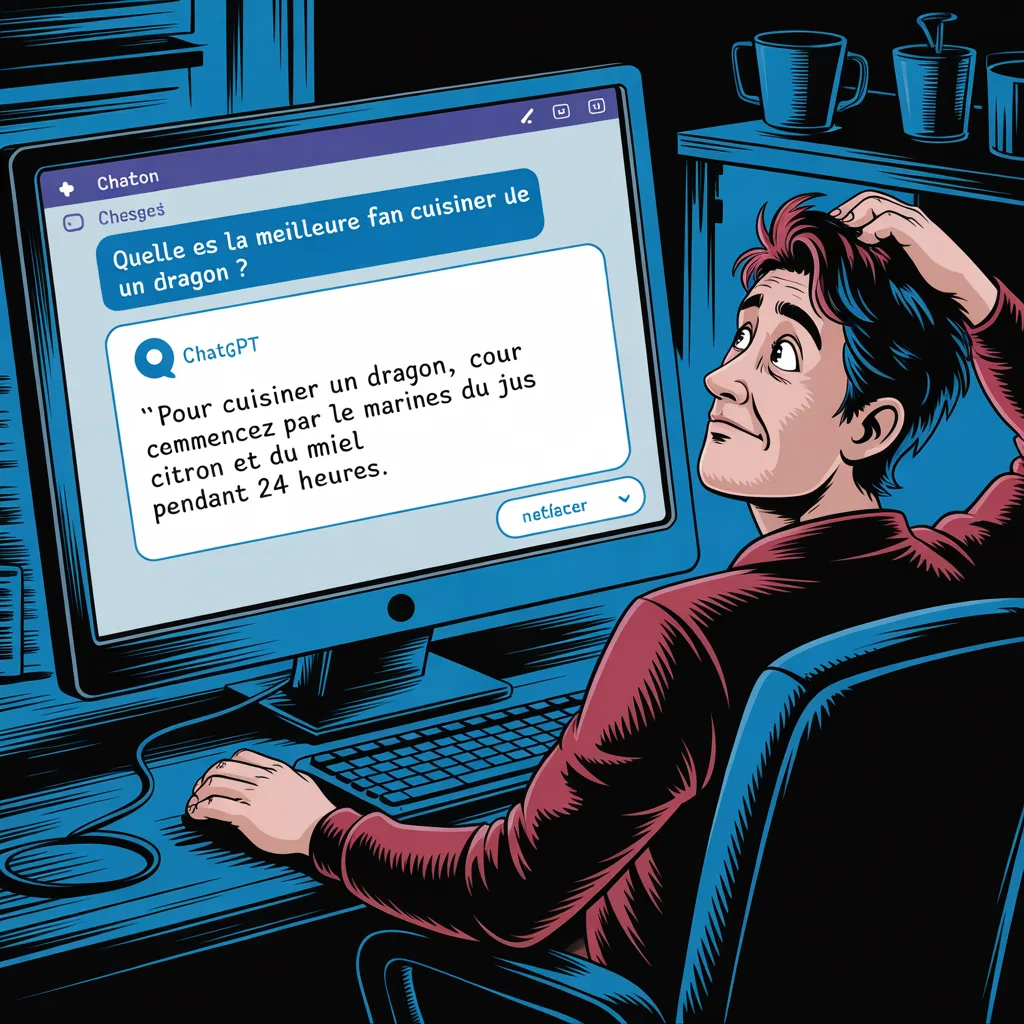

Un système d’IA générative ne vérifie pas la véracité des informations qu’il fournit. Il prédit la suite de mots la plus probable au regard des données sur lesquelles il a été entraîné. Cette mécanique peut conduire à des erreurs qui semblent crédibles, structurées et convaincantes.

Concrètement, une hallucination peut prendre la forme d’une citation inventée, d’un lien vers une page inexistante, d’un chiffre faux ou encore d’un ajout d’informations absentes du document source. Le phénomène devient particulièrement problématique lorsque l’IA est utilisée dans des environnements sensibles comme le diagnostic médical, l’analyse financière ou la production de contenus à forte valeur stratégique.

Le contenu d’origine analysé dans ce travail est issu du document fourni Hallucinations IA.

Pourquoi les modèles d’IA hallucinent-ils ?

Pour comprendre les hallucinations IA, il faut revenir au mode d’apprentissage des modèles. Ces systèmes sont entraînés sur de vastes ensembles de données et apprennent à repérer des régularités statistiques. Ils ne raisonnent pas comme un humain et ne disposent pas d’une compréhension consciente du réel.

Plusieurs facteurs expliquent l’apparition d’erreurs.

1. Des données d’entraînement incomplètes ou biaisées

La qualité des réponses produites dépend directement de la qualité des données d’entraînement. Si ces données sont incomplètes, déséquilibrées ou biaisées, le modèle peut intégrer des schémas erronés.

Prenons l’exemple d’un modèle médical entraîné principalement sur des images de tissus cancéreux. S’il ne dispose pas d’un nombre suffisant d’images de tissus sains, il peut apprendre à associer certains motifs visuels à une pathologie, même lorsque celle-ci est absente. Le résultat peut être un diagnostic erroné.

L’IA ne distingue pas intuitivement le vrai du faux. Elle reproduit des corrélations statistiques. Si ces corrélations sont imparfaites, les prédictions le seront également.

2. Le manque d’ancrage au réel

Un autre facteur clé est le manque d’ancrage factuel. Les modèles de langage manipulent des représentations textuelles. Ils ne possèdent pas d’accès direct au monde physique ni à une base de connaissances constamment vérifiée.

Cette absence d’ancrage peut conduire à la production d’informations cohérentes sur le plan linguistique mais incorrectes sur le plan factuel. Par exemple, un modèle chargé de résumer un article peut intégrer des éléments qui n’apparaissent pas dans le texte d’origine, simplement parce que ces ajouts semblent statistiquement plausibles dans un contexte similaire.

Ce phénomène explique également la création de références ou de liens fictifs. Le modèle anticipe qu’une source devrait exister et en génère une, sans vérifier sa réalité.

3. La logique probabiliste des LLM

Les grands modèles de langage fonctionnent sur une logique de probabilité conditionnelle. À chaque mot généré, ils évaluent la suite la plus probable en fonction du contexte précédent.

Cette mécanique ne repose pas sur la validation de la vérité, mais sur la cohérence statistique. Si une réponse semble vraisemblable au regard des données d’entraînement, elle sera produite, même si elle est objectivement incorrecte.

Autrement dit, la fluidité d’un texte ne garantit en rien sa fiabilité. C’est précisément ce qui rend les hallucinations difficiles à détecter sans vérification humaine.

Exemples concrets d’hallucinations IA

Les hallucinations peuvent prendre différentes formes selon le domaine d’application.

Dans le cadre de la prévision météorologique, un modèle peut annoncer de la pluie alors que les données actuelles ne soutiennent pas cette hypothèse. En cybersécurité ou en finance, un système de détection de fraude peut signaler une transaction légitime comme suspecte, générant un faux positif. À l’inverse, un faux négatif peut survenir lorsqu’un événement réellement problématique n’est pas détecté.

Dans la rédaction de contenu, l’IA peut inventer des statistiques, attribuer une citation à un auteur qui ne l’a jamais prononcée ou résumer un document en ajoutant des éléments inexistants.

Ces exemples illustrent une réalité simple : l’IA optimise la plausibilité, pas la véracité.

Comment limiter les hallucinations générées par l’IA ?

Même si les hallucinations ne peuvent être totalement supprimées, plusieurs leviers permettent de réduire significativement leur fréquence.

1. Limiter l’espace des réponses possibles

Encadrer le modèle réduit l’incertitude. En limitant le nombre de sorties possibles ou en appliquant des techniques de régularisation, il est possible de diminuer les prédictions extrêmes ou incohérentes.

Plus le cadre est strict, moins le modèle improvise. Cette approche est particulièrement pertinente dans les environnements critiques où la marge d’erreur doit être minimale.

2. Utiliser des données pertinentes et spécifiques

L’entraînement doit reposer sur des données adaptées à la tâche visée. Un modèle destiné à l’analyse médicale doit s’appuyer sur des jeux de données médicaux validés. Mélanger des sources hétérogènes ou peu fiables augmente le risque d’apprentissage de corrélations erronées.

La pertinence et la qualité des données constituent le socle de la fiabilité.

3. Structurer les sorties attendues

Imposer une structure améliore la précision des réponses. Lorsque l’on demande à une IA de produire un texte organisé avec un titre, une introduction, un développement structuré et une conclusion, on réduit la probabilité de dérive.

La structuration agit comme un cadre cognitif qui canalise la génération. En SEO, cela permet aussi d’améliorer la lisibilité et la cohérence sémantique.

4. Donner des consignes précises

La qualité du prompt influence directement le résultat. Indiquer explicitement les sources à utiliser, interdire l’invention de données ou demander une vérification factuelle permet de diminuer le taux d’hallucination.

Plus les instructions sont détaillées, plus le modèle dispose de contraintes claires. Le prompt engineering devient alors un levier stratégique pour encadrer la production.

Faut-il craindre les hallucinations IA ?

Les hallucinations IA ne rendent pas les modèles inutilisables. Elles rappellent simplement que ces outils ne sont pas des arbitres de vérité.

Dans une démarche SEO ou éditoriale, l’IA doit être considérée comme un accélérateur de production et d’idéation. La validation humaine reste indispensable pour vérifier les faits, contrôler les sources et corriger les approximations.

Plutôt que de craindre les hallucinations, il convient de les comprendre afin de mettre en place des garde-fous adaptés.

Conclusion : comprendre pour mieux encadrer

Les hallucinations générées par l’IA sont une conséquence directe du fonctionnement probabiliste des modèles de langage. Elles apparaissent lorsque les données sont incomplètes, biaisées ou mal contextualisées, mais aussi lorsque les instructions manquent de précision.

En améliorant la qualité des données, en renforçant l’ancrage factuel et en structurant les demandes, il est possible de réduire significativement ces erreurs. L’enjeu n’est pas d’atteindre une perfection absolue, mais de construire un cadre d’utilisation responsable et maîtrisé.

Sitographie

https://cloud.google.com/discover/what-are-ai-hallucinations

Ce contenu vous a plu ?

Inscrivez-vous gratuitement à notre newsletter et recevez chaque semaine l’actualité du SEO directement dans votre boîte email. Vous pouvez vous désabonner à tout moment !